- 相关博文

- 最新资讯

-

摘要 工业物联网、能源电力等领域的数据平台常面临通用数据库难以支撑时序数据的挑战。Apache IoTDB作为专为工业场景设计的时序数据库,具有高吞吐写入、高效压缩存储、原生支持设备树建模和复杂查询等优势。其核心能力包括: 工业级架构:支持设备层级管理、多协议兼容,适应复杂工业环境。 高性能读写:批量写入、时间范围查询、聚合降采样等原生功能优化。 成本控制:通过降采样降低长期存储开销,支持端边云协同部署。 生态集成:与Spark、Flink、Grafana等工具无缝对接,简化数据分析流程。 实际应用中,Io

-

场景推荐方案关键参数首次全量导出清空目标表 + INSERT先TRUNCATE目标表增量数据合并强一致性要求临时表 + 事务源数据可能重复先去重后导出预处理ROW_NUMBER去重小数据量单Map任务-m 1策略核心参数/方法适用场景解决原理更新/插入(Upsert)大部分日常同步场景将INSERT转换为UPDATE/INSERT混合临时表事务强一致性要求的关键数据两阶段提交,保证原子性源数据去重预处理ROW_NUMBER去重源数据本身有重复从根本上消除重复降低并行度-m 1。

-

与其内耗自己, 不如责备他人

-

本文介绍了一个基于Python和Django框架开发的招聘数据分析系统。系统采用Spark、Hive、Hadoop构建大数据处理框架,通过Selenium爬虫技术采集拉钩招聘数据。核心功能包括:可视化大屏展示城市薪资Top10、工资区间等多维度分析;薪资、经验学历、行业、城市等专项分析模块;招聘数据中心支持搜索收藏;基于内容推荐算法的职位推荐;基于TensorFlow的薪资预测模型;以及后台数据管理功能。系统实现了从数据采集、Spark分析到Web展示、推荐预测的全流程,为求职者提供全面的招聘数据分析服务。

-

本文详细介绍了如何将本地项目上传至GitHub私人仓库的完整流程。内容包括:1)安装Git和注册GitHub账号;2)创建私人仓库;3)本地项目初始化Git;4)配置用户信息;5)添加和提交文件;6)关联远程仓库;7)推送代码;8)验证上传结果。特别提供了SSH密钥配置指南和.gitignore文件创建说明,并附常见问题解决方案。适合需要安全托管私有项目的开发者参考。

-

本文详细介绍了Spark集群的部署过程,主要包括以下步骤:1.下载并解压Spark安装包;2.修改配置文件spark-env.sh;3.配置workers文件;4.解决节点文件缺失问题;5.启动Spark集群;6.运行示例程序测试。文章特别强调了部署过程中可能遇到的常见错误及解决方法,如workers文件路径错误、节点Spark目录缺失等问题,并提供了详细的解决方案。最后通过运行SparkPi示例程序验证部署结果。文章内容详实,配有具体命令和截图说明,适合Spark初学者参考学习部署过程。

-

消息中间件是分布式系统解耦和异步通信的核心组件。文章梳理了其发展历程,从早期的IBM MQ到现代的云原生Pulsar;对比分析了主流产品特性:RabbitMQ适合复杂路由,Kafka擅长高吞吐,RocketMQ提供事务支持,Pulsar面向云原生;给出了选型决策框架,建议根据吞吐量、延迟、功能需求等维度选择;最后总结了消息模型、可靠性保障等关键概念及最佳实践。文章强调技术选型应匹配业务场景,理解需求比追逐技术更重要。

-

本文深度解析ZooKeeper与Nacos两大分布式协调中间件:ZooKeeper专注强一致协调,基于ZAB协议与ZNode模型,适用于大数据生态;Nacos则提供AP/CP双模、三层数据隔离及长轮询机制,是云原生下配置中心+服务发现的一站式选择。二者核心能力、架构差异与选型建议全面对比,附生产实践与避坑指南。

-

本文介绍了一个基于Google Gemini (Vertex AI)的工单智能分类与信息提取批处理系统。该系统能自动处理Excel/CSV格式的工单数据,通过大模型进行多级标签分类和核心故障提取,具备高并发处理、自适应限流和断点续传等企业级功能。核心模块包括文件管理、LLM客户端认证、自适应并发控制、断点续传机制和结果解析等。系统采用动态并发调整算法,根据API调用情况自动优化吞吐量,并通过缓存机制实现任务中断恢复。最终输出包含多级标签、置信度评分和故障信息的结构化结果,显著提升工单处理效率。

-

本文介绍了如何利用Elasticsearch构建高效的内容搜索系统。针对传统数据库搜索性能差、排序单一等问题,作者通过倒排索引、中文分词等技术优化搜索体验。系统采用读写分离架构,将MySQL数据异步同步到ES,并冗余展示字段提升查询效率。索引设计遵循"检索用Text+分词,过滤用Keyword"原则,结合"索引宽、查询窄"的分词策略平衡召回率与准确率。搜索逻辑融合文本相关性、业务热度等多维度排序,使用search_after解决深分页问题。最终实现了毫秒级响应、精准排

-

在 Claude Code 封号潮和 API 成本高企的背景下,RTK 提供了一个非常优雅的解决方案。它通过消除 CLI 输出中的“噪音”,不仅显著降低了 token 成本(平均节省 80%+),还让同样的会话得以延长约 3 倍。更长的会话意味着 AI 能记住更多上下文,给出更准确、连贯的建议。无论你是在 macOS、Linux 还是 Windows 上开发,RTK 都是一个值得立即装上的“成本杀手”。

-

核心流程:Filebeat 采集 Nginx 日志 → Logstash 解析结构化 → ES 存储 → Kibana 可视化,通过 Docker Compose 可一键部署所有组件。关键配置:Logstash 的 grok 规则必须匹配 Nginx 的日志格式,否则日志无法正确解析。实用技巧:索引按天分片()便于日志管理,Kibana 索引模式关联@timestamp字段实现时间筛选。整个流程部署完成后,你可以实时监控 Nginx 的访问日志、错误日志,还能基于这些日志做性能分析、错误排查等。

-

这篇完整、专业、可直接用于开发 / 产品 / 对接文档,清晰说明淘宝商品详情 API 能做什么业务,并附上真实可解析的标准 JSON 返回示例,

-

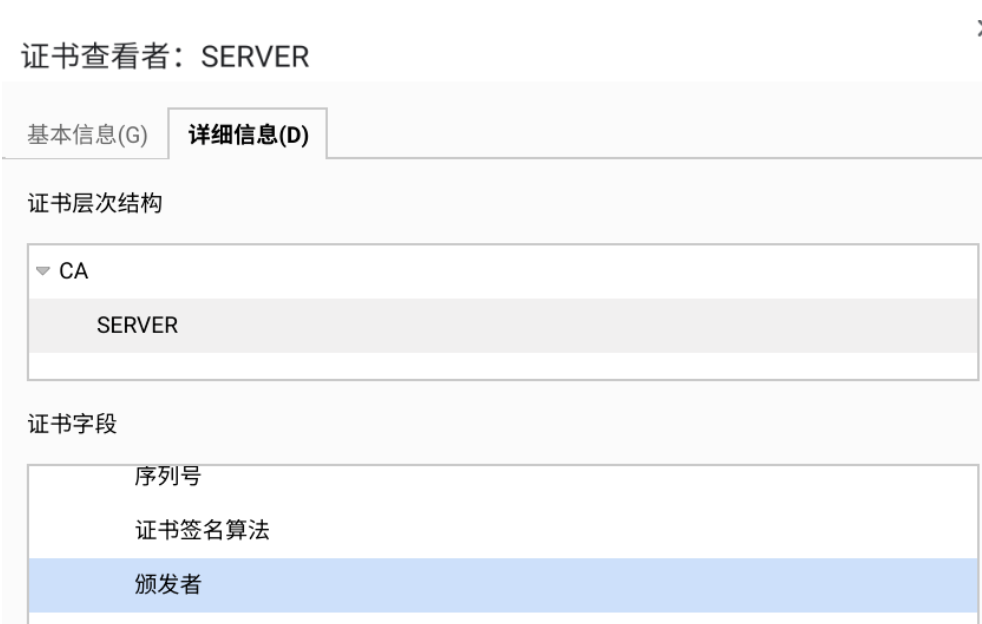

本文介绍了宝兰德应用服务器微服务版本V11.5.0接入ZooKeeper配置中心的完整流程。主要内容包括:接入ZooKeeper所需的依赖包、配置加载方式、关键配置项说明,以及详细的接入示例。示例展示了如何在ZooKeeper中创建配置节点、配置SpringBoot应用连接ZooKeeper获取配置,并演示了从配置中心获取JDBC连接池配置的实际应用场景。该方案支持通过属性文件或环境变量灵活配置,适用于需要集中管理微服务配置的企业级应用部署。

-

摘要: Apache Spark的Tungsten引擎通过堆外内存、缓存感知计算、向量化执行和WholeStage CodeGen四大机制,有效解决了JVM在大数据处理中的性能瓶颈。Tungsten采用UnsafeRow内存格式提升访问效率,利用缓存优化算法减少内存随机访问,通过向量化执行发挥CPU SIMD指令优势,并借助运行时代码生成消除虚函数调用开销。实际测试显示,Tungsten将Spark性能提升数倍至数十倍,尤其在高并发场景下效果显著。

-

本文详细介绍了Wiki.js知识库系统在在线和离线环境下的安装配置方法。在线环境采用Docker容器部署,包括PostgreSQL数据库和Wiki.js主程序的安装步骤,并推荐使用阿里云镜像加速下载。离线环境通过导出/导入Docker镜像实现,重点说明了语言包加载和Elasticsearch中文检索的配置技巧,包括分词插件安装和认证关闭等关键问题。文章还提供了Elasticsearch性能优化建议,以及解决配置文件冲突的实际经验,为不同网络环境下的Wiki.js部署提供了完整解决方案。

-

该方案构建了基于AI与大数据的智慧校园体系,核心建设物联网管控中心与3D可视化平台,实现设备智能管控与校园数字孪生。通过智慧教室、电子班牌、无感考勤、智能门禁等系统,融合统一门户、一卡通、办公及大数据评估应用,实现教学、管理、服务的全面智能化与数据驱动。:从设备故障诊断、课堂考勤、板书提取到学业评估,全面嵌入人工智能;:软硬件统一平台,数据标准化,避免信息孤岛;:涵盖教学、管理、安防、办公、评估等校园全业务;:构建学生、教师、设备、资产等多维度数据分析与预警体系;

-

摘要:Elasticsearch的Jeff Vestal介绍了如何评估向量搜索的召回率。文章对比了精确搜索(flat)和近似搜索(HNSW)的性能,使用DBPedia-14数据集测试发现,在40,000文档规模下召回率仍保持98.8%。Elasticsearch通过BetterBinaryQuantization(BBQ)技术实现高效检索:先用压缩向量快速遍历HNSW图获取候选文档,再用全精度值重新排序。实验表明量化优化几乎不影响结果质量,建议开发者根据自身数据特点进行基准测试。

-

本文总结了Git使用过程中遇到的典型问题及解决方案。作者在项目初始化时未配置.gitignore文件,导致敏感文件被误提交到GitHub。在尝试删除文件时,又因操作不当引发冲突,最终通过删除重建仓库彻底解决问题。文章详细记录了从误传文件、冲突处理到彻底删除的完整过程,并提炼出核心经验教训:1.项目初始化必须配置.gitignore;2.提交前务必检查git status和git diff;3.敏感信息一旦推送应立即处理;4.SSH比HTTPS更稳定;5.复杂操作前应先备份。

-

本文介绍如何利用Cursor编辑器的.cursorrules配置文件提升前端开发效率。该文件作为AI与项目间的"说明书",可持久化存储项目框架、目录结构、编码规范等信息,减少重复提示。文章详细讲解传统.cursorrules单文件和新版.cursor/rules/目录两种配置方式,提供Vue3、React、微信小程序等技术栈的配置策略,并给出3套可直接使用的完整模板(Vue3+TS、React+TS、微信小程序)。最后给出使用建议:先写通用规则再细化文件级规则,保持简洁并配合示例,让AI

-

-

-

-

-

-

甲骨文承诺能帮助客户尽快上手员工健康和安全管理解决方案,提供相关的白皮书,在其中列出配置基本安全事件报告的详细步骤,并在整个4月为客户提供线上支持服务,协助客户完成配置工作。

-

当企业通过上云实现转型时,迁移是一个重要的无法回避的话题。 迁移是为了提高企业信息架构和应用的敏捷性,从而助力企业快速创新和发展;迁移也是为了提高企业全球化和数字化的水平。我们从正在进行转型的公司中看到,通过云迁移实现架构和应用的现代化,主要有四个大趋势。

-

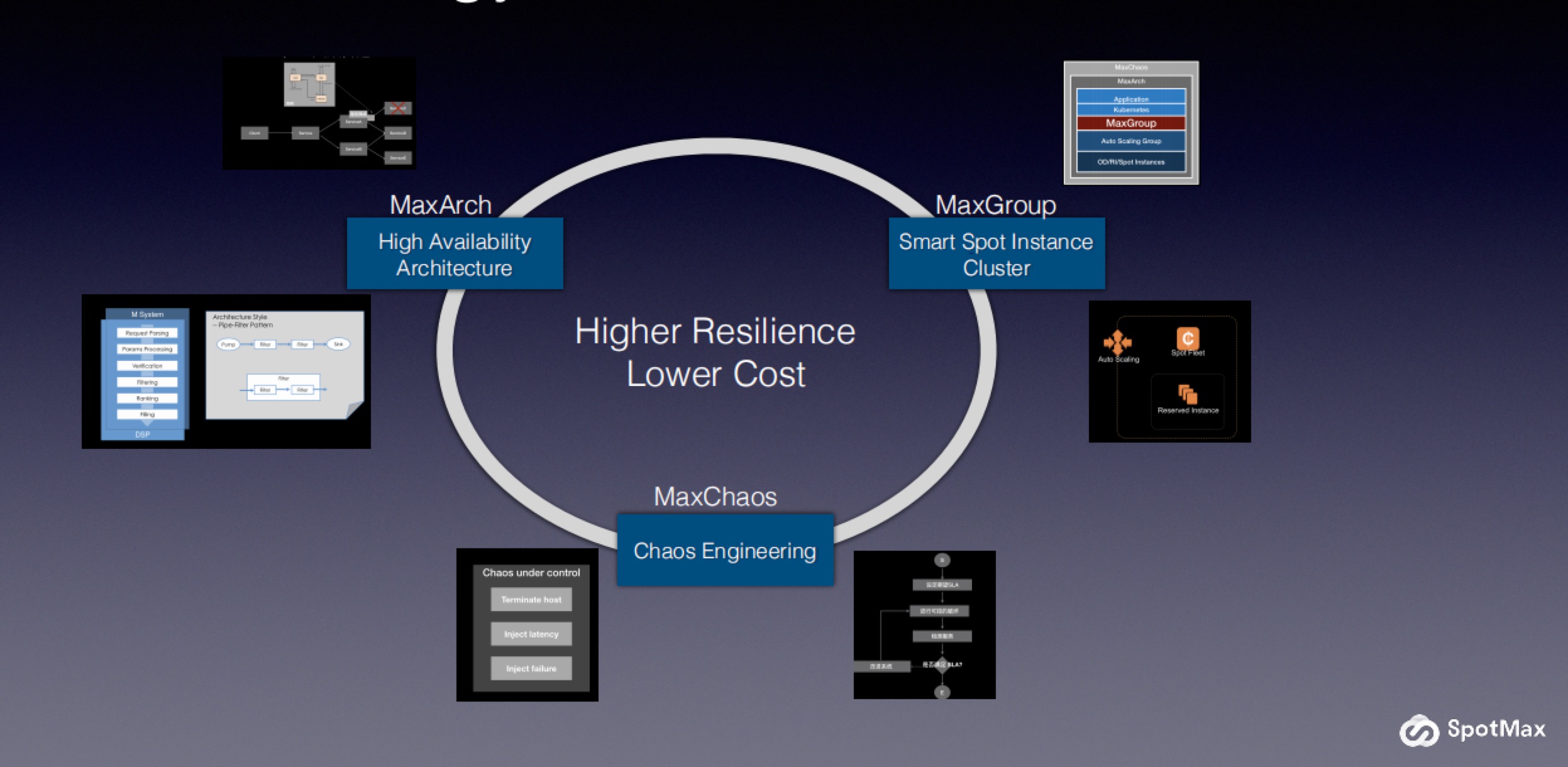

就在不久前,Mobvista刚刚发布了2019年的财报数据。我们观察到其程序化广告收入已高达22.3亿元,同比增长40.8%;经调整后EBITDA达3.6亿元,同比增长高达19.5%……试想仅仅上市一年,Mobvista在增长放缓的大环境下依然能够取得如此“高光时刻”,可见其发展势头不容小觑。

-

-

近年来,我国文化产业蓬勃发展,文化产业价值年均增速远高于同期 GDP 增速,尽管中 国演出市场在开放竞争中逐步规范有序,但目前仍处于起步和培育阶段,尚不够完善和成熟。尤其在演出场馆基础设施、管理运营等方面参差不齐。

-

Apache Kafka 是一个快速、可扩展的、高吞吐的、可容错的分布式“发布-订阅”消息系统, 使用 Scala 与 Java 语言编写,能够将消息从一个端点传递到另一个端点。

-

要想理解持续集成和持续部署,先要了解它的部分组成,以及各个组成部分之间的关系。下面这张图是我见过的最简洁、清晰的持续部署和集成的关系图。

-

数据库是应用及计算机的核心元素,负责存储运行软件应用所需的一切重要数据。为了保障应用正常运行,总有一个甚至多个数据库在默默运作。我们可以把数据库视为信息仓库,以结构化的方式存储了大量的相关信息,并合理分类,方便搜索及使用。

-

Spark3.0发布了,代码拉过来,打个包,跑起来!| 附源码编译

Spark3.0已经发布有一阵子了,官方发布了预览版,带来了一大波更新,对于我们程序员来说,首先当然是代码拉过来,打个包,跑起来!!

-

提到MySQL的事务,我相信对MySQL有了解的同学都能聊上几句,无论是面试求职,还是日常开发,MySQL的事务都跟我们息息相关。

-

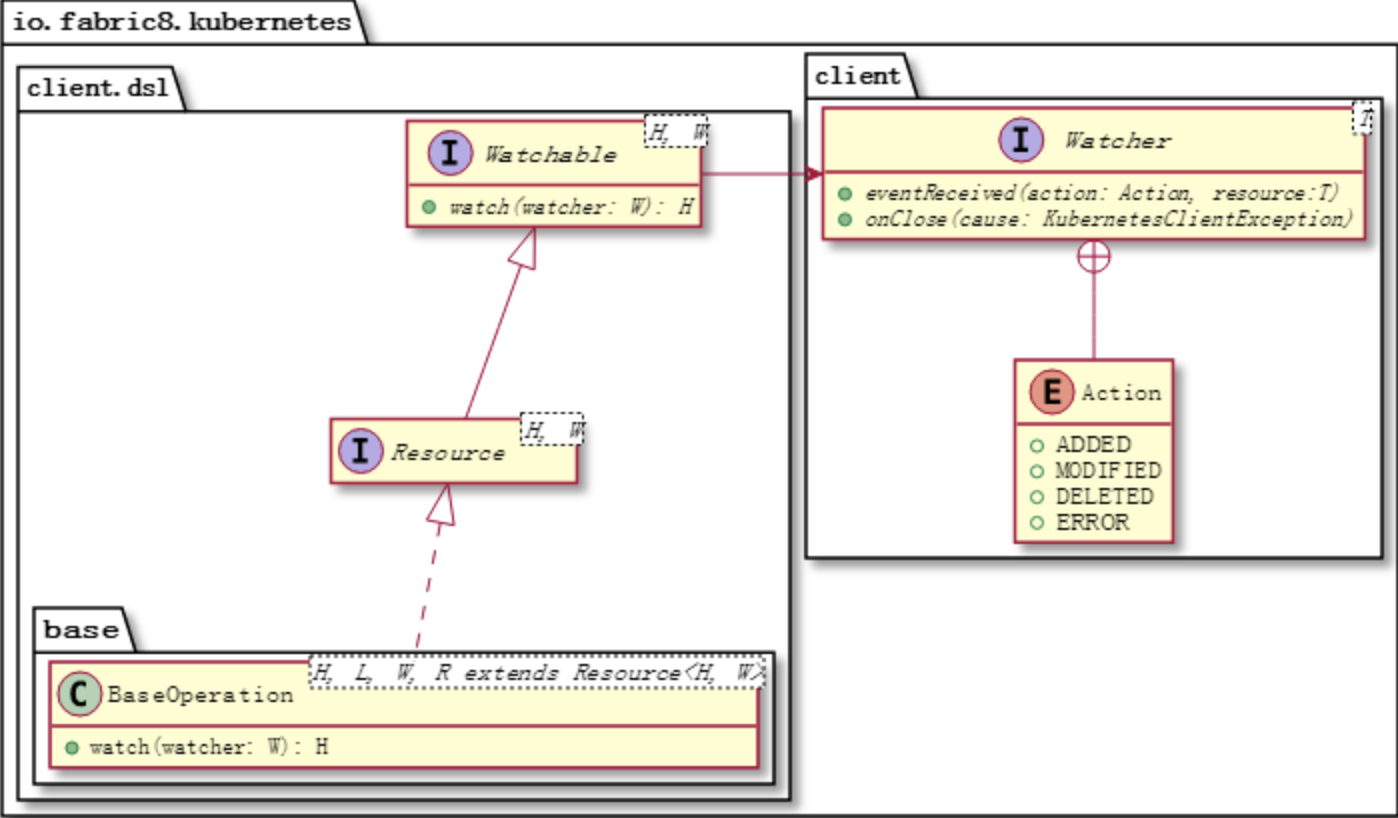

从代码到 Docker、Kubernetes、Istio、Knative……,或许是时候重新思考从代码到云的编程了...

早些时候,开发人员只需编写程序、构建,然后运行。如今,开发人员还需要考虑各种运行方式,作为可执行文件在机器上运行(很有可能是虚拟机),还是打包到容器中;将容器部署到Kubernetes中,还是部署到serverless的环境中或服务网格中。然而,这些部署方式并不是开发人员编程经验的一部分。开发人员必须以某种方式编写代码才能在特定的执行环境中正常工作,因此编程时不考虑这些问题是不行的。

-

最近,安全圈又有一个大新闻,微博名为@安全_云舒的微博用户在发文称:“很多人的手机号码泄露了,根据微博账号就能查到手机号……已经有人通过微博泄露查到我的手机号码,来加我微信了。”