- 相关博文

- 最新资讯

-

摘要: 时序数据库选型需关注写入性能、存储效率、查询能力、架构扩展性及生态兼容性。Apache IoTDB作为物联网原生时序数据库,具备千万级点/秒写入、高压缩比(10:1~20:1)、毫秒级聚合查询及边缘-云协同能力,支持SQL与大数据生态(Spark/Flink)深度集成。其自研TsFile列式存储和分层压缩技术显著降低存储成本,适用于工业物联网、能源电力等大数据场景,TCO较传统方案降低60%以上,是时序数据管理的优选方案。

-

异步是 RabbitMQ 的一个重要作用。我们可以用生活中的例子理解。解耦也是 RabbitMQ 的重要作用。购买服务 ---> 课表服务这两个服务之间关系很紧。如果课表服务代码改了,购买服务可能也要跟着改。购买服务 ---> 课表服务购买服务 ---> 积分服务购买服务 ---> 通知服务购买服务 ---> 短信服务这样购买服务会越来越复杂。购买服务 ---> RabbitMQRabbitMQ ---> 课表服务RabbitMQ ---> 积分服务RabbitMQ ---> 通知服务。

-

拥有国家级专精特新“小巨人”资质,150+自主知识产权,业务覆盖全国28省、80+城市、300+产业园区,多个省份科技金融平台共建和运营单位,制造业大省企服智能体、头部百强区产业招商智能体、千亿国资平台投资研判智能体技术方,是赛道内可落地、合规性强的标杆企业。优质产业AI赛道必须具备明确落地场景,当前行业公认高壁垒刚需场景包含:产业分析、科技金融、产业招商、企业服务、投资研判。其中产业治理、产业招商等政企服务与科技金融赛道,摆脱粗放式增长,成为政策重点扶持、落地能力最强的细分领域。综合来看,2026年。

-

版本:Claude Code CLI日期:2026/05/12。

-

我们已经详细探讨了如何赋予大模型“记忆(Memory)”和“手脚(Tool Use)”。然而,单纯的 Agent 依然面临一个致命缺陷:大模型的知识仅限于其训练数据,它不知道企业内部的私有规章制度、文档或最新的技术方案,这就会导致严重的“幻觉”。为了解决这个问题,ai-agent-rag 项目在 ai-agent-chat 的基础能力(记忆+触手)之上,引入了 RAG(检索增强生成) 技术。

-

Kafka与Java的关系在大数据和实时数据处理领域备受关注。作为一款用Java语言开发的分布式流处理平台,Kafka天然与Java生态系统高度兼容。Java的稳定性和高性能使其成为Kafka运行的理想选择,而Kafka的高吞吐量和低延迟特性则为Java应用提供了强大的实时数据处理能力。在企业级应用中,Kafka常与Java结合使用,用于实时日志处理、消息队列和流数据传输等场景。

-

在 64 核乃至 256 核的现代服务器上,这种模型会遭遇严重的 cache coherence、false sharing、锁竞争问题。现在选型不是替换,而是评估 —— 一旦你的业务命中 Pizza 官方列出的那七种场景(毫秒延迟、PB 级、可变数据、复杂 JOIN、高并发、千字段少变更、结构化+非结构化统一),Pizza 就值得放进你的雷达图。本文从产品定位、设计哲学、核心概念、分布式架构、实时机制、WASM 生态、典型场景到与 Elasticsearch 的对照,做一次全方位、成体系的拆解。

-

三套系统各自覆盖完整的业务闭环,但数据彼此独立。同一笔订单从电商平台产生后,业务数据停留在聚水潭或领星,财务数据需要人工二次录入金蝶;库存变动在业务系统发生,财务账面无法实时感知;跨境业务涉及汇率换算、出口退税、海外平台费用等复杂场景,手工处理效率低且易出错。采用中心辐射(Hub-and-Spoke)架构,以数据集成平台作为中央枢纽,三套业务系统作为外围节点。任意两系统之间不直接通信,所有数据交互通过中央枢纽进行协议转换、字段映射与路由分发。基础数据需先在金蝶中审核通过后,方可进行业务单据对接。

-

本文系统剖析了Flink流处理中的两种核心状态类型--KeyedState与OperatorState,对比了两者的特性差异,并给出最佳实践。

-

大家好,我是迪哥。从 2019 年到 2026 年,我们的消息队列架构换了三波——从 ActiveMQ 到 RocketMQ,再到 Kafka 与 RocketMQ 并存。今天就聊聊,什么时候用 Kafka,什么时候用 RocketMQ,以及如何把它们搭得高可用。

-

以互联网大厂面试为故事背景:严肃面试官围绕电商AIGC导购平台,从Java/JVM、Spring Boot微服务、Redis/Kafka、监控链路追踪到AI RAG/Agent、向量库与安全风控逐步提问。水货程序员小Y简单题能答,复杂题含糊。文末给出每题详细答案与业务落地解析,适合小白系统学习。

-

一套在(本地)虚拟机中模拟完全分布式Hadoop环境搭建过程,适配3.0以上版本;对潜在踩坑都做了预判,能够快速上手这门非遗技术。

-

如果所有的 ISR(同步副本)都挂了,剩下的只有数据版本非常旧的副本。这个新 Leader 并没有包含之前已经确认的消息,将该参数设为 false(默认值),宁愿牺牲可用性(停止服务)也不要丢失数据。:enable.idempotence=true,即使生产者因为网络原因多次发送同一条消息,Broker 也会通过序列号(Sequence Number)去重(可靠性的一部分,但不解决丢失,解决重复)虽然不是每条消息都立刻调用 fsync(为了性能),但配合副本机制,即使单机断电,数据依然在其他副本中。

-

本来用centos7安装来着但是打开图形化界面之后,编译文件总报内存不足错误(我给了9G内存+单线程编程仍然错误,固转而使用Ubuntu系统)Uubntu24.04.3 适配的VTK版本只有9.1,配置文件不好安装,所以我换了22版本的Ubuntu,后来又换成20.04版本的了。下面的是我的makefile.usr文件,和我环境一样可以复制(注意涉及到liggghts下载路径的语句需要更改,就是上面列出的MPI_INC 、VTK_INC_USR的路径)退出root: ctrl+D。

-

对于长期经营型企业来说,未来真正重要的已经不是“是否拥有线上商城”,而是是否拥有自己的用户体系、数据体系与业务系统。

-

介绍了WebSocket在Nginx和Spring Boot中的完整配置方案。Nginx端配置了WebSocket支持、3600秒超时设置、TCP优化和长连接保持。Spring Boot端通过@ServerEndpoint注解实现WebSocket服务端,包含连接管理、心跳检测和消息推送功能,并使用线程池处理异步任务。定时任务组件每15秒向所有连接的客户端推送监控数据。解决方案包含完整的异常处理机制,并强调客户端ID(userId)必须使用随机不重复值。该方案实现了稳定的长连接通信,适用于实时数据监控场

-

数据的时间范围为 2011 年~2025 年,由于百度指数只提供 2011 年以来的数据。16 个词语各省市的百度指数数据:大数据、电子商务、互联网、平台经济、数字经济、网贷、网联、物联网、信息化、在线支付、网络银行、网银、移动互联、移动支付、智慧城市、智慧交通。2011年~2025年各城市(日度).dta。2011年~2025年各城市(月度).dta。2011年~2025年各城市(年度).dta。2011年~2025年各省份(日度).dta。2011年~2025年各省份(月度).dta。

-

深入对比高斯溅射、Three.js、WebGL等主流Web3D渲染技术,包含原理剖析与可直接运行的完整HTML代码示例。

-

Apache Gravitino 是一个统一的元数据管理平台,旨在打破数据孤岛,为Data+AI资产提供单一事实来源。它的核心优势在于架构、对海量引擎和AI工作的原生支持,以及从被动的元数据服务向主动的“元数据驱动行动系统”的演进。主要特点常见用例。

-

摘要:防火门新规全面实施,国标GB55037-2022和GB12955-2024对防火门设计、选材、施工等全流程提出强制性要求。新规将防火门按使用场景分类(T/S/F类),强化烟密闭性能,新增抗冲击要求,并规范安装运维标准。过渡期存在产品合规争议,住宅入户门改造受限。建议设计、施工、物业等各环节严格遵循新规,重点关注门缝密封、五金配件等细节,杜绝私自改造行为。工程人员需掌握消防图纸识图、规范理解等核心技能,确保项目合规落地。(149字)

加载中...

-

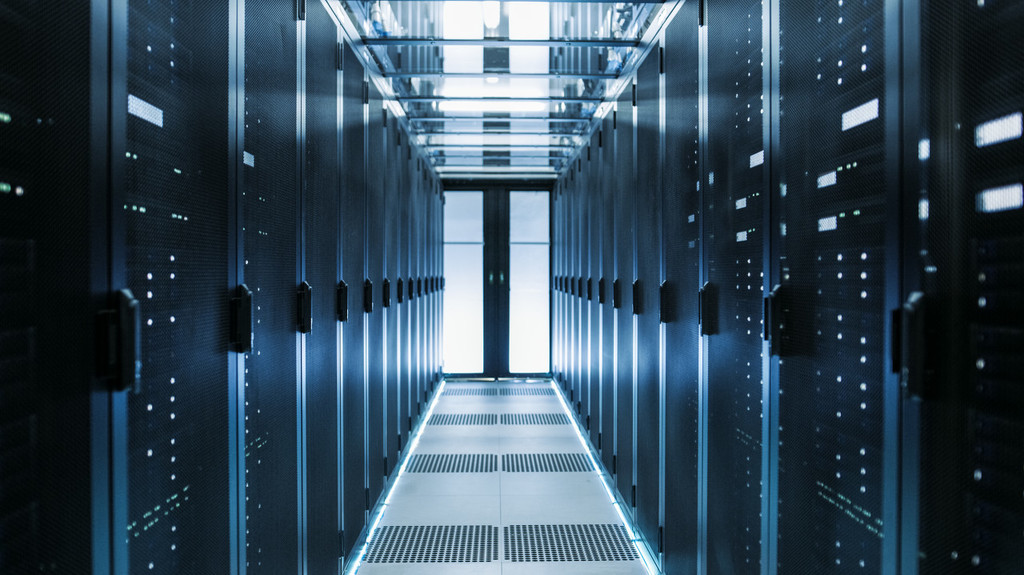

服务器对每个从事IT工作的人来说并不陌生,但是服务器所涉及的各种知识细节,并非大家都十分清楚,为了让大家深入了解服务器的关键知识点,笔者特意抽时间总结了这篇科普文章,旨在帮助读者全面了解服务器。今天内容就从服务器的架构和分类开始。

-

Q:什么是Spark?A:简单理解,Spark是在Hadoop基础上的改进,是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行计算框架,Spark基于map reduce算法实现的分布式计算,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出和结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的map reduce的算法。

-

进程(process)和线程(thread)是操作系统的基本概念,但是它们比较抽象,不容易掌握。最近,我读到一篇材料,发现有一个很好的类比,可以把它们解释地清晰易懂。