- 相关博文

- 最新资讯

-

摘要: 本文详细解释了Spark Driver端与Worker端在OSS认证上的核心区别。Driver端通过Spark配置自动认证,而Worker端(独立Python进程)需显式提供认证信息。认证来源优先级为:1)Driver传递参数,2)环境变量,3)IAM角色。文章分析了架构差异导致的不同认证方式,并推荐从Driver传递认证信息的解决方案。当前实现已采用该方案,通过Spark配置或环境变量获取认证后传递给Worker进程,确保PyArrow能正确访问OSS数据。

-

python双算法小说推荐系统 在线阅读+书架管理 python小说推荐系统 协同过滤算法 Django框架 大数据毕业设计 deepseek(附源码+文档)✅ 计算机毕业设计

-

【Zookeeper】CAP理论——CAP介绍

-

随机森林算法详解,随机森林(Random Forest)是一种集成学习算法

-

Temporal Table Function (TTF) 是 Flink 中一种按时间访问维表版本的表函数,它将 append-only 表包装成随时间变化的维表。通过 LATERAL TABLE(func(时间列)) 语法,可以查询指定时间点的数据版本。TTF 只能基于 append-only 流定义,不支持 changelog 输入,且必须通过 Table API 注册。与 Versioned Table 相比,TTF 是较早期的解决方案,适用于只有 append-only 源的场景,而 Versio

-

稀疏检出(Sparse Checkout)是 Git 的功能,允许只检出仓库中的指定目录或文件,而不是整个仓库。对于大型数据集,这能显著减少下载时间和存储占用。使用克隆仓库使用初始化使用指定要下载的目录验证下载结果这种方法可以显著减少下载时间和存储空间,适合只需要部分数据集的场景。注意事项确保有足够的磁盘空间妥善保管 OAuth token大型数据集下载可能需要数小时,建议使用screen或tmux保持会话参考资源Git Sparse Checkout 官方文档。

-

本文介绍了如何使用SpringBoot集成Elasticsearch实现商品搜索功能。主要内容包括:1)准备工作,包括环境配置和Elasticsearch核心概念;2)SpringBoot集成步骤,涵盖依赖添加、配置设置、实体类创建、Repository定义和服务层实现;3)搜索功能实现,包括全文搜索和分类筛选;4)中文分词配置和高级功能如高亮显示。通过对比传统数据库LIKE查询,Elasticsearch搜索速度提升10倍以上。文章还提供了完整的代码示例和测试方法,帮助开发者快速构建高效的搜索功能。

-

本文系统介绍了Hive窗口函数的使用方法,包括9种常用窗口函数的语法、功能和应用场景。通过员工工资表的示例数据,详细演示了ROW_NUMBER、RANK、DENSE_RANK等排名函数,SUM OVER、AVG OVER等聚合函数,以及LAG、LEAD等偏移函数的实际应用。文章还包含窗口函数在面试中的高频问题,适合学习、面试和实战参考。

-

腾讯云TBDS与Cloudera CMP在大数据平台选型中存在明显差异:TBDS优势在于深度国产化支持(信创适配、等保合规)、AI原生能力及低成本模型,特别适合国内金融政务场景;而CMP强项在于全球合规认证、Impala的OLAP性能及多云统一管理能力,更适合跨国企业。主要缺陷对比:TBDS存在生态封闭(绑定腾讯云)、跨云能力弱的问题;CMP则面临在华落地困难、许可成本高昂(约5千美元/核/年)及缺乏国产化支持的短板。企业选型需重点考虑业务地域性、合规要求及现有技术栈。

-

Kafka Console UI是一款专为Apache Kafka设计的轻量级Web管理平台,通过直观的可视化界面简化复杂的Kafka集群运维工作。无论您是Kafka新手还是经验丰富的运维人员,这款免费工具都能帮助您快速掌握多集群监控方案和实时消息追踪,让Kafka管理变得前所未有的简单。## 🚀 五分钟极速部署体验### 环境准备与快速启动**前置要求:**- Java 8或更高

-

【Zookeeper】ZAB协议

-

流程存在优化空间,需要系统指导以避免低效探索,实际项目应以解决问题为导向。

-

从基础类型到复杂结构 本文系统介绍了 Apache Flink 中的 DataType 体系,涵盖逻辑类型与物理表示的差异,并详细解析了各类数据类型: 基础标量类型:包括字符串(CHAR/VARCHAR/STRING)、数值(DECIMAL/INT/DOUBLE)、布尔值、日期时间(DATE/TIMESTAMP_LTZ等)以及二进制类型 时间间隔类型:YEAR-MONTH和DAY-SECOND两种粒度的INTERVAL 复杂结构类型: 集合类:ARRAY、MAP、

-

但是有时候,在执行Python代码时,出现Python代码执行的速度比较慢,想要通过一些方法提高Python代码的执行速度。multiprocessing模块分别给work01()和work02()启动一个进程,与主进程一共3个进程,这3个进程是同时进行的。在使用多进程的情况下,Python代码是同时执行work01()和执行work02(),代码运行消耗的时间大约3.5秒。在不使用多进程的情况下,Python代码是先执行work01(),再执行work02(),代码运行消耗的时间大约6秒。

-

RAG架构数据库选型指南:向量数据库、传统数据库扩展与图数据库三大流派解析。文章对比了Pinecone、PostgreSQL(pgvector)、Elasticsearch、Neo4j等主流方案的特点与适用场景,指出专用向量库适合海量数据和高性能需求,传统数据库扩展适合混合检索需求,图数据库则擅长复杂推理场景。同时提供了RAG实施流程(ETL-R)和选型决策的四个关键问题,帮助开发者根据数据规模、查询复杂度、技术栈现状和隐私要求选择最适合的数据库方案。

-

本教程使用所有软件版本:pycharm 25.2 ,spark 3.4.2 ,hadoop 3.3.3。

-

git push origin main出错,关键可能是main

-

RabbitMQ死信队列的队头阻塞问题源于FIFO机制下首个无法消费的消息会阻塞后续合法消息。常见场景包括消费逻辑缺陷、资源不可用等,导致消息积压、业务延迟等危害。解决方案包括:1)消费端增加异常捕获和校验逻辑;2)按业务/错误类型拆分多死信队列;3)引入优先级队列;4)建立监控告警和手动干预机制。关键在于预防性设计和快速响应机制的结合,确保死信队列的高可用性。

加载中...

-

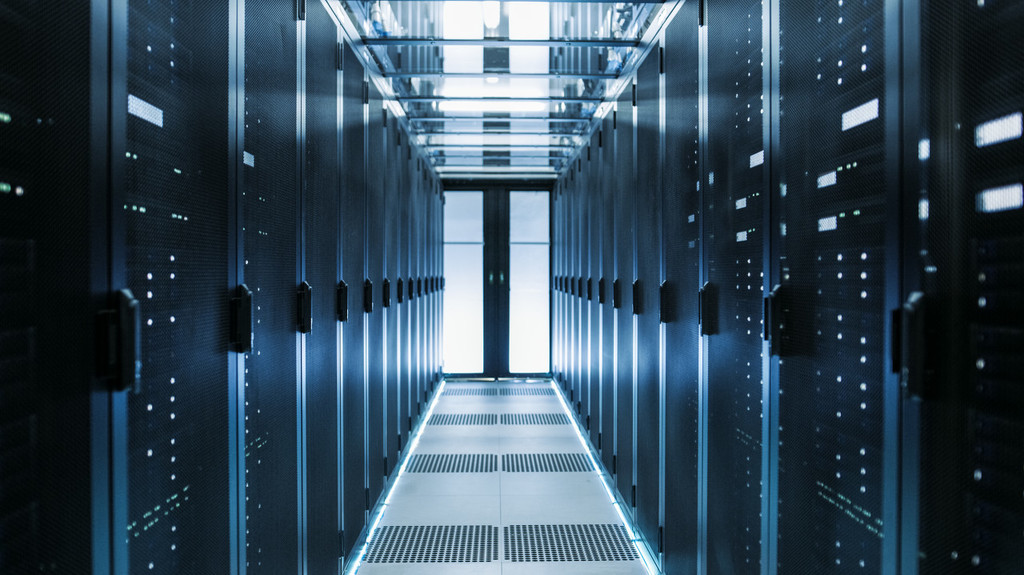

服务器对每个从事IT工作的人来说并不陌生,但是服务器所涉及的各种知识细节,并非大家都十分清楚,为了让大家深入了解服务器的关键知识点,笔者特意抽时间总结了这篇科普文章,旨在帮助读者全面了解服务器。今天内容就从服务器的架构和分类开始。

-

Q:什么是Spark?A:简单理解,Spark是在Hadoop基础上的改进,是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行计算框架,Spark基于map reduce算法实现的分布式计算,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出和结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的map reduce的算法。

-

进程(process)和线程(thread)是操作系统的基本概念,但是它们比较抽象,不容易掌握。最近,我读到一篇材料,发现有一个很好的类比,可以把它们解释地清晰易懂。